BÜRGERRAT GEGEN MEINUNGSFREIHEIT

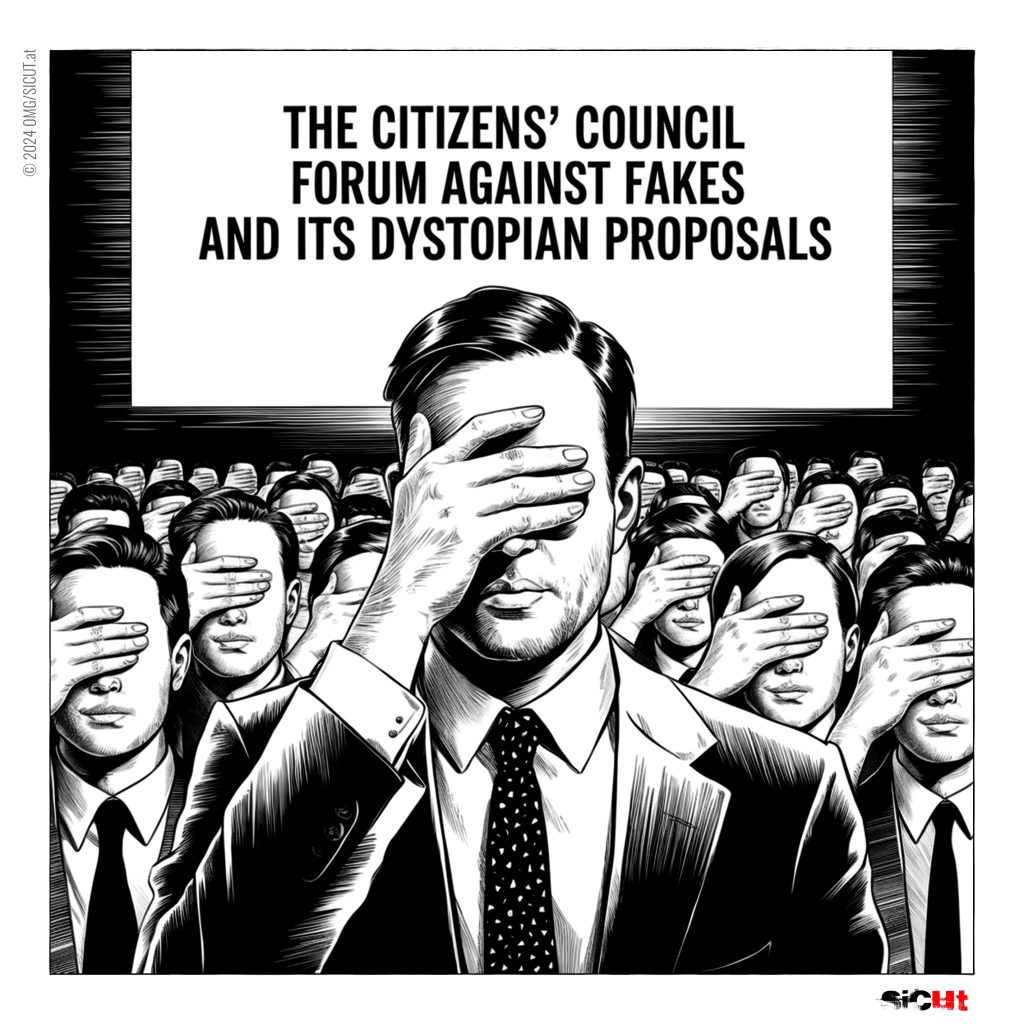

Der Bürgerrat Forum gegen Fakes und seine dystopischen Vorschläge

Die Sphinx der Online-Zensur

In einer Ära, in der Informationen in Echtzeit durch die digitalen Kanäle schießen, mag der Gedanke an eine „angemessene Bedenkzeit“ von zwei bis fünf Minuten für Social Media Posts wie ein Relikt aus dem analogen Zeitalter erscheinen. Doch genau diese surreal anmutende Idee ist ein zentraler Vorschlag des Bürgerrats Forum gegen Fakes. Laut der Vorstellung der 139 Teilnehmer, die sich mit dem Gutachten „zum Umgang mit Desinformation“ hervorgetan haben, sollte das spontane Posten in den sozialen Medien einer Art Vorprüfung unterzogen werden. Die Methode sieht vor, dass Nutzer ihre Beiträge einer kurzen Überlegungsfrist unterziehen, bevor diese veröffentlicht werden dürfen. Der rationale Kern dieser Idee mag darin bestehen, dass eine solche Bedenkzeit helfen könnte, impulsive, potenziell schädliche Äußerungen zu vermeiden. In der Praxis jedoch deutet diese Maßnahme auf ein erschreckendes Misstrauen gegenüber der Urteilsfähigkeit des Einzelnen hin und steht im direkten Widerspruch zur Grundidee der freien Meinungsäußerung, wie sie in der digitalen Demokratie verankert ist.

Diese Bedenkzeit ist nicht nur eine reine Verzögerungstaktik, sondern auch ein Mittel, um die Kontrolle über die Inhalte weiter zu zentralisieren. Die Vorstellung, dass eine Künstliche Intelligenz (KI) nach einer festgelegten Zeitspanne über die Veröffentlichung eines Beitrags entscheidet, zeugt von einer beunruhigenden Bereitschaft zur Überwachung und Zensur. Die KI soll dabei auf „sensible Themen“ wie Migration aufmerksam werden – ein Begriff, der sowohl weitreichend als auch gefährlich interpretiert werden kann. Die Frage bleibt, wer letztlich die Kriterien für „sensible Themen“ festlegt und wie neutral diese KI in ihrer Beurteilung tatsächlich ist. Diese Art der Zensur, verkleidet als Schutzmaßnahme, stellt eine massive Einschränkung der individuellen Freiheit dar und öffnet Tür und Tor für eine normative Überwachung des öffentlichen Diskurses.

Die dystopische Vision des Bürgerrats

Neben der Bedenkzeit für Social Media Posts enthält das Gutachten des Bürgerrats Forum gegen Fakes auch Vorschläge für ein umfassendes Meldeportal und die strafrechtliche Verfolgung von Desinformationen. Während die Idee eines Meldeportals an sich nicht neu ist, da bereits viele soziale Netzwerke solche Systeme implementiert haben, zeigt sich in diesem Kontext eine alarmierende Tendenz zur Überwachung und Kontrolle von Inhalten. Ein Meldeportal für „Desinformation“ soll es Nutzern ermöglichen, verdächtige Beiträge zu melden, die dann von den zuständigen Stellen überprüft werden. Hier stellt sich die Frage, ob die Nutzer eines solchen Portals tatsächlich die objektive Fähigkeit besitzen, Desinformation von legitimen, wenn auch kontroversen Äußerungen zu unterscheiden.

Noch besorgniserregender ist jedoch der Vorschlag zur Strafverfolgung von Personen, die Desinformationen verbreiten. Diese Maßnahme impliziert eine rechtliche Repression gegen individuelle Äußerungen, die nicht dem offiziellen Narrativ entsprechen. Die Vorstellung, dass Menschen strafrechtlich belangt werden können, weil sie Informationen teilen, die als „desinformierend“ eingestuft werden, ist ein direkter Angriff auf die freie Meinungsäußerung und die Pressefreiheit. Solche Maßnahmen könnten dazu führen, dass kritische Stimmen, die sich gegen die vorherrschende politische Meinung stellen, mundtot gemacht werden. Die Definition von „Desinformation“ wird hier durch einen ideologischen Filter laufen, der nicht nur die Meinungsvielfalt einschränkt, sondern auch die Grundlage für eine Orwellsche Überwachungsstaatlichkeit legt.

Die Utopie der Implementierung

Der Bürgerrat Forum gegen Fakes hat mit seinen 15 Politikempfehlungen einen theoretischen Rahmen für die Bekämpfung von Desinformation geschaffen, der in der Praxis jedoch auf massive Widerstände stoßen dürfte. Die Implementierung der vorgeschlagenen Maßnahmen würde nicht nur erhebliche technische und ethische Herausforderungen mit sich bringen, sondern auch grundlegende Fragen zur Verhältnismäßigkeit und Fairness aufwerfen. Die Vorstellung, dass ein Algorithmus oder ein staatlich kontrolliertes System darüber entscheidet, welche Informationen verbreitet werden dürfen und welche nicht, bringt die Gefahr mit sich, dass die Gesellschaft zunehmend in ein Klima der Selbstzensur und der ideologischen Homogenität gedrängt wird.

Zusätzlich bleibt die Frage offen, wie effizient und effektiv die vorgeschlagenen Maßnahmen tatsächlich sein könnten. Die Annahme, dass ein KI-System oder ein Meldeportal in der Lage ist, Desinformation zuverlässig zu identifizieren und zu filtern, ist an sich schon fragwürdig. Die Komplexität der menschlichen Kommunikation und die Vielfalt der Kontextualisierungen machen es nahezu unmöglich, eine „Wahrheit“ zu definieren, die allen gerecht wird. In der Praxis könnte dies zu einer gefährlichen Vereinheitlichung der Meinungen führen, in der nur noch der Mainstream-Narrativ Gehör findet und abweichende Perspektiven als „desinformierend“ gebrandmarkt werden. Es bleibt abzuwarten, ob diese utopischen Vorstellungen in der Realität umsetzbar sind oder ob sie als gescheiterte Experimente enden werden, die mehr Schaden als Nutzen anrichten.